| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

- 머신러닝

- 데이터 전처리

- 이것이 코딩테스트다

- 데이터 분석

- 이코테

- pandas

- ML

- 데이터분석

- sklearn

- 회귀분석

- 딥러닝

- 코딩테스트

- tableau

- matplotlib

- 태블로

- 파이썬

- Google ML Bootcamp

- SQLD

- 시각화

- SQL

- 데이터분석준전문가

- scikit learn

- Python

- 자격증

- ADsP

- IRIS

- r

- pytorch

- Deep Learning Specialization

- 통계

- Today

- Total

목록통계학과 수업 기록 (19)

함께하는 데이터 분석

[회귀분석] Simple Linear Regression with R

[회귀분석] Simple Linear Regression with R

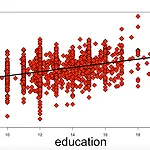

오늘은 R을 이용하여 simple linear regression을 알아보겠습니다. 데이터는 wages.Rdata를 사용했습니다. 데이터 불러오기 setwd("경로") load("wages.Rdata") attach(wages) setwd를 통하여 자신의 경로를 설정한 다음 load를 통해 경로 안에 있는 파일을 불러오면 됩니다. attach를 통하여 데이터를 불러옴으로써 data.frame에서 column을 wages$logwage가 아닌 logwage라고 쓸 수 있게 됩니다. 데이터 구조 파악하기 str(wages) >>> 'data.frame':2178 obs. of 2 variables: $ education: num 16.8 15 10 12.7 15 ... $ logwage : num 2.85 ..

[데이터 마이닝] 연관성 분석(Association Analysis)

[데이터 마이닝] 연관성 분석(Association Analysis)

이번에는 데이터 마이닝의 분석방법 중 하나인 연관성 분석을 알아보겠습니다. 연관성 분석의 정의 데이터 안에 존재하는 항목 간의 연관 규칙(association rule)을 발견하는 과정 마케팅에서 손님의 장바구니에 들어있는 품목 간의 관계를 알아본다는 의미에서 장바구니 분석이라고도 함 연관성 분석의 예시 - 가장 유명한 예시로 월마트의 맥주와 기저귀입니다. 아내의 부탁으로 기저귀를 사갈 때 맥주를 같이 사간다는 분석입니다. 연관성 규칙의 조건 두 품목(품목 A와 B)이 함께 구매한 경우의 수가 일정 수준 이상이어야 함(일정 이상의 지지도) 품목 A를 포함하는 거래 중 품목 B를 구입하는 경우의 수가 일정 수준 이상이어야 함(일정 이상의 신뢰도) 그렇다면 이번에는 지지도와 신뢰도 등, 연관성 분석의 평가 ..

[회귀분석] Simple linear regression 검정

[회귀분석] Simple linear regression 검정

오늘은 simple linear regression에서 검정(test)을 공부해보겠습니다. 귀무가설 대립가설 세우기 우리는 simple linear regression에서 β_0인 intercept 부분보다 β_1인 기울기 부분에 관심이 있습니다. 그래서 귀무가설에 β_1 = 0을 놓고 우리가 궁금해하는 대립가설에 β_1 =/ 0으로 설정했습니다. 일반적인 가설검정이라고 볼 수 있죠. 그런데 저번 포스트에서 M_0 모델과 M_1 모델을 살펴본 것이 기억나세요? 모델의 관점에서 M_0 모델이 옳은가, M_1 모델이 옳은가로 가설검정을 세우면 위의 기울기의 관점과 동치가 됩니다. M_0 모델은 x_i인 설명변수가 없는 모델이지만 M_1 모델에서 β_1이 0이 되면 x_i가 의미가 없어지기 때문이죠. 그렇다면..

[회귀분석] SSE와 결정계수 R^2

[회귀분석] SSE와 결정계수 R^2

오늘은 SSE와 결정계수(R^2)에 대해 알아보겠습니다. 저번 시간에 SSE에 대해서 알아봤는데 오늘은 2가지 model에 대해 SSE를 알아보겠습니다. M_0 model의 SSE m_0 model은 독립변수인 x_i가 없는 모델입니다. 빨간색 x표시가 observation인데 Y축 위에 있는 것을 볼 수 있죠. 이때 SSE는 위와 같습니다. SSE는 Sum of Square Estimation의 약자이죠. M_1 model의 SSE M_1 model이 우리가 알고 있는 simple linear regression입니다. M_1의 SSE가 우리가 말하는 일반적인 SSE입니다. M_0과 M_1 model의 SSE비교 observarion에서 회귀선으로 내린 선분의 제곱한 값이 SSE인 것은 다들 알고 계실..

[데이터 마이닝] Cluster Analysis

[데이터 마이닝] Cluster Analysis

오늘은 비지도학습인 Cluster Analysis(군집분석)을 공부해보겠습니다. Clustering 이란? - 데이터에서 속성(input variables)에 따라 데이터들(observations) 간의 유사성을 측정하여 군집(cluster)을 찾는 것 - 군집을 찾을 때는 같은 군집 내의 데이터들은 가능한 동질성을 갖게 하고, 군집 간 데이터들은 가능한 이질성을 갖게 해야 함 Cluster Analysis의 활용 고객의 세분화 고객의 맞춤 관리 구매패턴에 따른 신상품 판촉 교차판매 유사성 거리 측도 Euclidean Distance : 직선 거리 Manhattan Distance : ㄱ자 거리 Mahalanobis Distance : 표준화와 상관성을 동시에 고려한 거리 이때 S는 표본 공분산 행렬 S..

[데이터 마이닝] 의사결정나무(Decision Trees)

[데이터 마이닝] 의사결정나무(Decision Trees)

오늘은 데이터 마이닝의 분석방법 중 하나인 의사결정나무를 알아보겠습니다. 의사결정나무의 정의 - 과거에 수집된 데이터들을 분석하여 이들 사이에 존재하는 패턴 즉, 범주별 특성을 속성의 조합으로 나타내는 분류 모형 의사결정나무의 목적 - 새로운 데이터에 대해 분류(Classification)하거나 해당 범주의 값을 예측하는 것 변수 유형에 따른 분류 범주형 : 분류나무(Classification Tree) 연속형 : 회귀나무(Regression Tree) 의사결정나무 구성요소 노드(Node) 가지(Branch) 깊이(Depth) : 깊어질수록 복잡도 상승 제일 위의 신용도에서 가지가 쳐서 나오므로 root node라고 하고 마지막 노드를 terminal node라고 합니다. 여기서 신용도와 나이, 성별을 ..

[회귀분석] Simple linear regression LSE·MLE

[회귀분석] Simple linear regression LSE·MLE

안녕하세요. 오늘은 단순 선형 회귀모형에서 모수인 β_0, β_1을 추정하기 위한 방법으로 LSE(least Square Estimation)과 MLE(Maximum Likelihood Estimation)을 알아보겠습니다. 단순 선형회귀식 이때 입실론을 남기고 좌변으로 넘기면 아래의 식이 완성됩니다. 입실론 입실론은 그래프 상으로 위와 같은 파란색 선분의 길이입니다. 이때 LSE(Least Square Estimation)는 즉, 길이의 제곱의 합이 최소가 되는 최소제곱법을 나타냅니다. Fitting Model SSE(Sum of Square Estimation) 우리가 가장 많이 쓰는 방법입니다. 우리의 목표는 입실론의 제곱의 합이 최소가 되게 하는 것이죠. SAD(Sum of Absolute Dif..

[데이터 마이닝] 로지스틱 단순회귀모형

[데이터 마이닝] 로지스틱 단순회귀모형

안녕하세요! 오늘은 로지스틱 단순 회귀모형에 대해 알아보겠습니다. 위의 사진에서 주황색 그래프가 로지스틱 회귀 곡선입니다. 로지스틱 회귀모형은 설명변수인 x는 연속형이든 범주형이든 상관없지만 반응변수인 y는 보통 범주가 2개인 0, 1을 나타냅니다. 그럼 이제 로지스틱 단순 회귀모형을 공부할 때 필요한 기본개념을 설명하겠습니다. 오즈(Odds) : 성공확률이 실패 확률에 비해 몇 배 더 높은가 오즈(odds)를 상대적 가능성이라고도 표현합니다. 오즈의 범위는 0 < odds < ∞ 입니다. 로짓 변환(logit transform) : 오즈에 로그를 취해서 p의 범위가 [0,1] 일 때 (-∞,+∞)로 변환 y=a+bx에서 로지스틱 회귀모형에서 반응변수는 [0,1]을 가져야 하는데 설명변수에 따라 0보다 ..

[데이터 마이닝] 분석기법 분류

[데이터 마이닝] 분석기법 분류

안녕하세요! 오늘은 간단하게 데이터 마이닝의 분석기법 분류를 알아보겠습니다. 데이터 마이닝은 크게 2가지인 지도학습(Supervised Learning)과 비지도학습(Unsupervised Learning)으로 나뉩니다. 그렇다면 지도학습과 비지도학습의 차이는 무엇일까요? 지도학습은 종속변수인 y값 (output)이 존재하고 예측 분석 기법이라고도 말하죠. 비지도학습은 종속변수인 y값 (output)이 존재하지 않고 설명 분석 기법을 말합니다. 지도학습에는 대표적으로 Classification(분류분석)과 Regression(회귀분석)이 있는데 Classification과 Regression은 각각 종속변수가 범주형이냐 연속형이냐에 따라 나뉩니다. (선형회귀라고 가정) 비지도학습에는 대표적으로 Clust..

[데이터 마이닝] 데이터분석과 방법론 개요

[데이터 마이닝] 데이터분석과 방법론 개요

안녕하세요! 오늘은 데이터 마이닝을 소개하기까지 간단한 개요를 소개하겠습니다. 분석 대상과 방법 데이터 분석은 대상(What)과 분석의 방법(How)에 따라 4가지 유형으로 나눌 수 있습니다. 한 가지 주제의 분석이라도 상황에 따라 4가지 유형으로 분석을 수행하고 결과를 도출할 수 있습니다. 분석 기획시 고려할 사항 1. 가용데이터에 대한 고려(Available Data) 2. 적절한 활용방안과 활용사례(Proper Business Use Case) 3. 장애요소들에 대한 사전 계획 수립(Low Barrier of Excution) 분석 방법론 1. KDD 분석 방법론 2. CRISP-DM 방법론 위의 두 가지의 방법론이 존재합니다. 그중 데이터 마이닝의 과정을 포함하고 있는 KDD 방법론을 알아보겠습니..